Édition 59 - Une brève histoire de l'intelligence artificielle

#59 De la Renaissance de l'IA à aujourd'hui (Partie 2)

Si vous aimez mon contenu, cliquez sur le ❤ au-dessus et à côté de mon nom pour m’aider à remonter sur Substack ou Gmail et parce que ça me donne encore plus envie de faire mieux la prochaine fois 😊

C’est vendredi, le jour d’EthicGPT ! 😊 Je suis très heureux de vous retrouver pour cette 59e édition !

Si quelqu’un vous a transféré cette édition et que le contenu vous plaît, n’hésitez pas à vous abonner et à la transférer également. Cela m’aidera beaucoup pour faire connaître mon travail 😌

Quelques liens utiles si jamais vous débarquez ici pour la première fois :

Mon site internet où je présente mon activité

Vous souhaitez sponsoriser cette newsletter ? C’est par ici

Mes formations Juristes Augmentés et Découvrir Mistral AI

La présentation et les archives de cette newsletter

Prêt(e) à consacrer ces quelques sur l’IA avec moi ? C’est parti 🚀

Je continue mes éditions estivales, avec la 2e partie de ma brève histoire de l’IA générative.

La semaine dernière, j’ai fait un voyage dans le passé, en explorant les débuts fascinants de l'IA jusqu'à l'Hiver de l'IA. Aujourd'hui, on va continuer cette aventure, en plongeant dans la renaissance de l'IA jusqu'à nos jours. En gros, comment on en est arrivé à ChatGPT.

Si vous n’avez pas lu la première partie, c’est par ici.

Le renouveau des réseaux neuronaux et l'apprentissage profond

Après l’hiver, le printemps ! Les années 1990 marquent le début d'une véritable renaissance pour l'IA et tout commence avec la réémergence des réseaux neuronaux artificiels. Ces structures inspirées du cerveau humain ont été mises un peu de côté pendant l'hiver de l'IA, mais des chercheurs comme Geoffrey Hinton, Yann LeCun et Yoshua Bengio redécouvrent leur potentiel, notamment grâce à la méthode de rétropropagation. Cette technique permet aux réseaux de "s'entraîner" en ajustant leurs poids internes, un processus essentiel pour améliorer leur performance.

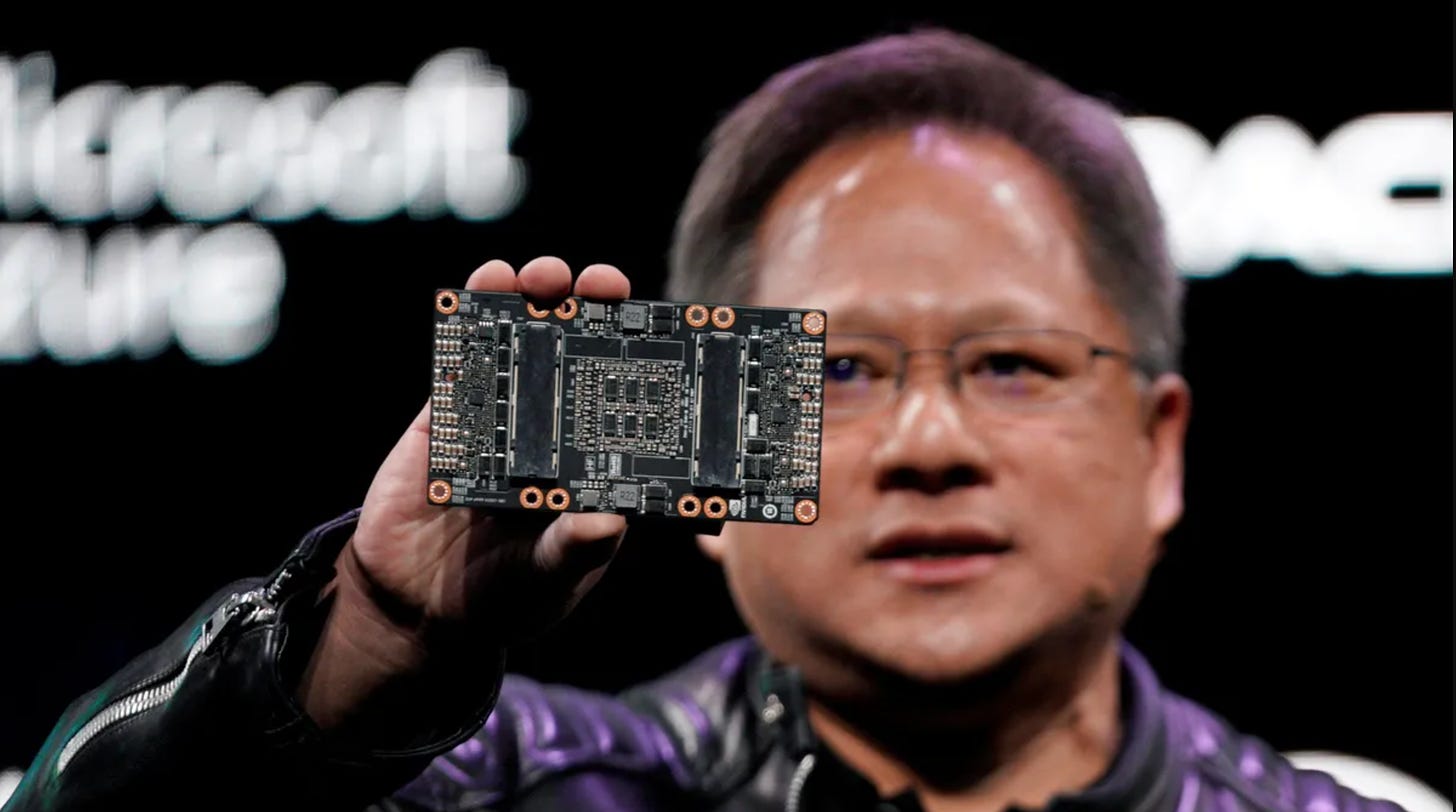

L'avancée technologique joue également un rôle clé. L'augmentation de la puissance de calcul, particulièrement avec l'émergence des GPU (grossièrement, la puissance des cartes graphiques) permet d'entraîner des réseaux neuronaux de plus en plus complexes. Ces processeurs, initialement conçus pour les graphismes, se révèlent parfaits pour les calculs massivement parallèles nécessaires à l'apprentissage profond. C’est pour ça qu’aujourd’hui, Nvidia est surpuissante.

Ce qu’on appelle le deep learning devient alors le moteur des nouvelles avancées en IA. Les réseaux convolutifs (Convolutional Neural Networks, ou CNNs), développés par Yann LeCun, montrent une efficacité inédite dans la reconnaissance d'images, un domaine où les systèmes symboliques avaient échoué. Ces réseaux sont capables de détecter des motifs complexes dans les données, ouvrant la voie à des applications révolutionnaires, du diagnostic médical à la reconnaissance faciale.

Cette période est véritablement celle où l'IA commence à passer du laboratoire à la réalité, posant les fondements de nombreuses technologies que nous utilisons aujourd'hui. La renaissance des réseaux neuronaux et l'avènement du deep learning marquent un tournant décisif dans l'histoire de l'IA, transformant ce qui était autrefois considéré comme science-fiction en une réalité tangible et omniprésente.

Les victoires historiques de l'IA dans les jeux de stratégie

Les années 1990 sont également marquées par des victoires historiques de l'IA dans le domaine des jeux de stratégie, qui servent de terrain d'expérimentation privilégié pour tester et démontrer les capacités des machines. Rappelez-vous, dans la partie 1, je parlais de l’abandon des financements pour les IA non-spécifiques. Cependant, pour les IA très spécifiques, les financements n’ont pas été arrêtés. Or, une IA très spécifique, c’est une IA utile pour un cas d’usage qui intéressera peu de monde, intérêt au sens professionnel du terme, et qui servira donc de test. Et les jeux de stratégie sont l’exemple parfait.

Le premier événement marquant survient en 1997 lorsque Deep Blue (Deeper Blue même !), un superordinateur développé par IBM et dopé à l’IA, bat le champion du monde d'échecs Garry Kasparov dans un match en six parties.

Cette victoire est perçue comme un jalon majeur pour l'IA, démontrant que les machines peuvent surpasser l'intelligence humaine dans des tâches spécifiques, même dans un domaine aussi complexe que les échecs.

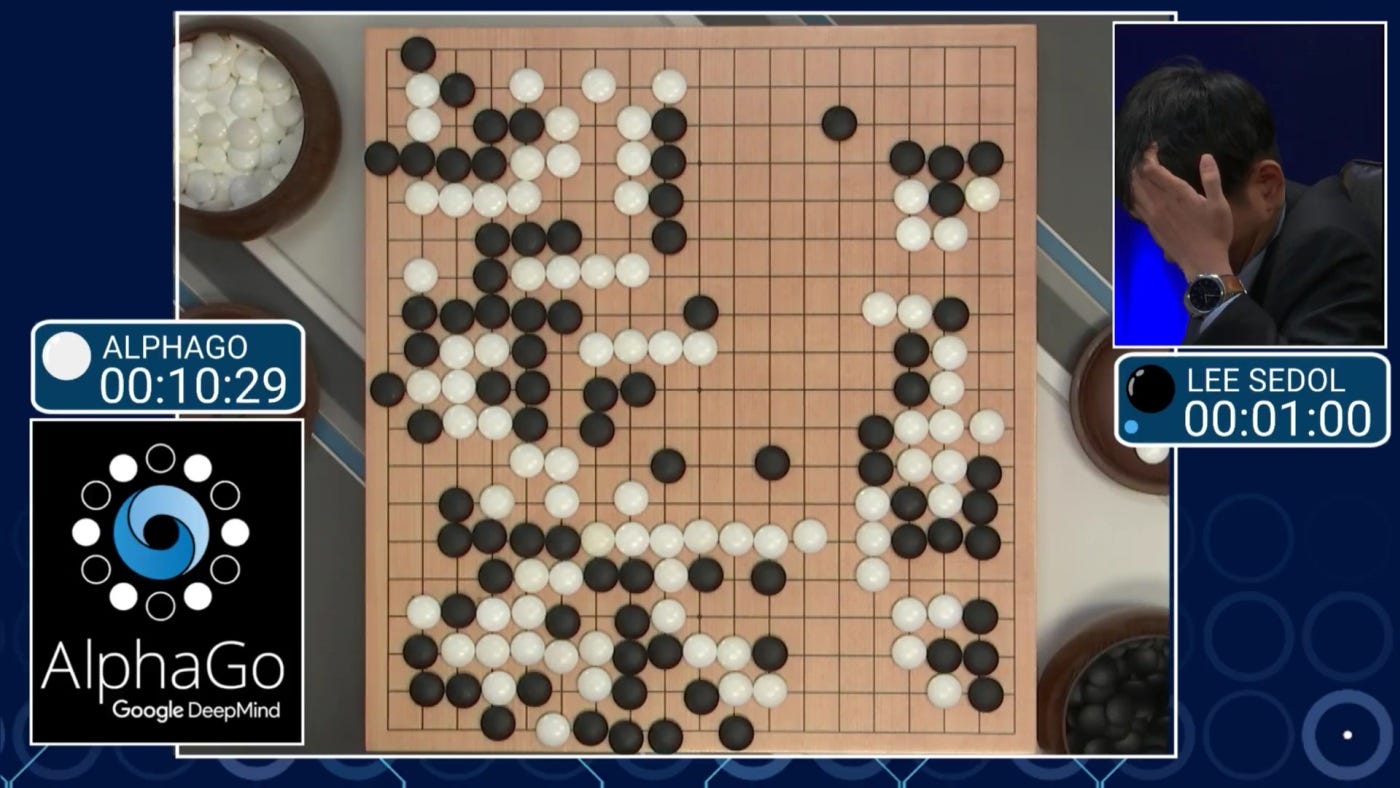

Il a fallu 20 ans pour que l’IA franchisse une étape encore plus impressionnante avec AlphaGo, un programme développé par DeepMind, une filiale de Google. AlphaGo parvient à battre Lee Sedol, l’un des meilleurs joueurs de Go au monde, un jeu infiniment plus complexe que les échecs en raison de son immense nombre de combinaisons possibles. Contrairement à Deep Blue, qui s’appuyait principalement sur la puissance brute pour calculer d’innombrables possibilités, AlphaGo utilise des techniques d'apprentissage profond (deep learning) et des réseaux neuronaux pour évaluer les positions de jeu et anticiper les mouvements. Bref, l’IA qu’on a aujourd’hui.

Ces victoires dans les jeux de stratégie ne sont pas seulement des exploits techniques et elles ont aussi une portée symbolique. Elles montrent que l'IA est capable d'exceller dans des environnements qui nécessitent de l'intuition et de la stratégie, des qualités longtemps considérées comme intrinsèquement humaines. De plus, ces succès ouvrent la voie à des applications plus larges de l'IA dans des domaines tels que la médecine, la finance, et bien d'autres, où la prise de décision complexe est essentielle.

Ainsi, les succès de Deep Blue et d’AlphaGo illustrent non seulement la progression rapide de l’IA, mais aussi son potentiel à résoudre des problèmes qui, autrefois, semblaient hors de portée des machines.

L'essor de l'IA appliquée dans les années 2000

Les années 2000 marquent l'émergence de l'IA appliquée dans des domaines du quotidien. Le moteur de recherche Google, lancé à la fin des années 1990, devient un acteur central de cette révolution. Grâce à des algorithmes de plus en plus sophistiqués, Google transforme la manière dont nous accédons à l'information en ligne. Les algorithmes de recherche et de recommandation, alimentés par des techniques d'apprentissage automatique, sont capables de trier, analyser et proposer du contenu pertinent parmi des milliards de pages web. Donc, si jamais vous ne le saviez pas, le moteur Google, c’est bien de l’IA !

Parallèlement, l'explosion des données (big data) joue un rôle essentiel dans cette nouvelle ère de l'IA. La quantité massive de données disponibles permet d'entraîner des modèles d'IA avec une précision et une efficacité sans précédent. Les entreprises commencent à exploiter ces données pour améliorer leurs processus, comprendre leurs clients et prendre des décisions stratégiques. Le big data, combiné au machine learning, devient le fondement de l'IA moderne, offrant aux machines la capacité d'apprendre et de s'améliorer au fil du temps. En gros, plus on a des données disponibles et exploitations, plus on peut améliorer des modèles d’IA.

L'IA commence également à s'inviter dans la vie quotidienne avec des succès grand public comme avec Siri d’Apple et Alexa d’Amazon. Lancés au début des années 2010, ces assistants utilisent des techniques de traitement du langage naturel pour comprendre et répondre aux commandes vocales des utilisateurs. Pour la première fois, l'IA n'est plus confinée aux laboratoires ou aux applications spécialisées, elle devient accessible à tous !

Ces avancées montrent que l'IA ne se contente plus d'être une curiosité technologique ou un outil pour les experts. Elle devient une composante essentielle de notre quotidien, intégrée dans une multitude de services et d'applications qui facilitent notre vie, souvent sans que nous en soyons pleinement conscients.

L'âge d'or de l'IA (années 2010 - 2020)

Les années 2010 marquent l'entrée de l'IA dans ce que beaucoup appellent son "âge d'or". Cela fait une décennie où l’IA dépasse largement les cercles de spécialistes pour devenir un sujet de société et un moteur d'innovation dans de nombreux secteurs. L’un des événements les plus emblématiques de cette période, je l’ai évoqué plus haut, c’est la victoire d’AlphaGo contre Lee Sedol au jeu de go.

Pendant cette décennie, l'IA progresse également de manière spectaculaire dans le domaine de la reconnaissance d'images et de la vision par ordinateur. Les CNNs permettent aux machines de surpasser les humains dans des tâches comme la classification d’images ou la détection d’objets. Ces avancées trouvent des applications concrètes, de l’amélioration des diagnostics médicaux à la conduite autonome, où des véhicules sont capables de "voir" et d'interpréter leur environnement pour naviguer en toute sécurité.

Parallèlement, l'IA générative commence à faire parler d'elle. Des modèles comme BERT de Google en 2018 pour les LLMs et le texte, et Goodfellow pour les images en 2014, repoussent les frontières de ce que l'IA peut créer. C’est en 2018 qu’une entreprise que vous connaissez tous aujourd’hui, OpenAI, lance son GPT-1 (Generative Pre-Trained Transformer). Concurrent de BERT parmi les LLMs, GPT-1 est rapidement suivi par GPT-2 et surtout, par GPT-3 en 2020.

GPT-3 est le premier LLM aisément accessible au grand public. Il est capable de générer des textes étonnamment cohérents et sophistiqués, dans des outils comme Jasper. Je connais quelques personnes qui ont utilisé Jasper en 2021 et 2022, et qui n’étaient pas au courant qu’il y avait un LLM qui tournait derrière, qui puis-est celui d’OpenAI ! Je ne l’aurais pas su non plus…

Les années 2010-2020 ont non seulement montré que l'IA pouvait apprendre, percevoir et créer, mais aussi qu'elle est prête à jouer un rôle central dans l'innovation future.

On est en 2024 et ce que vous voyez aujourd’hui n’est que la conséquence de ce qui est arrivé avant. GPT-4o, Claude 3,5 Sonnet et Midjourney ne sont donc pas des révolutions, mais des évolutions rapides de choses commencées près de 10 ans auparavant, et même plus si on parle des débuts de l’IA.

Quels sont les défis contemporains et les perspectives d'avenir pour l’IA ?

Aujourd’hui l’IA semble transformer le monde. En tout cas, c’est ce que beaucoup disent. Et cela engendre des discussions, défis et perspectives, plus ou moins réjouissantes.

L'une des principales préoccupations actuelles est la question de l'éthique dans le développement et l'application de l'IA. Les biais algorithmiques, qui surviennent lorsque les systèmes d'IA reproduisent ou amplifient des préjugés présents dans les données d'entraînement, sont devenus un problème central et discuté. Ces biais peuvent mener à des résultats au mieux problématiques, au pire catastrophiques. Rappelez-vous l’histoire des soldats nazis et noirs.

En parallèle, la protection des données, sujet qui me parle, est un autre défi de taille. Avec l'IA, la collecte et l'analyse de vastes quantités de données sont devenues monnaie courante, soulevant des questions sur la confidentialité et l'utilisation des informations personnelles.

L'impact de l'IA sur le marché du travail est également au centre des débats et j’y ai d’ailleurs consacré une édition de cette newsletter. L'automatisation de certaines tâches par l'IA risque de remplacer des emplois, notamment dans les secteurs manufacturiers et des services. Toutefois, l'IA crée également de nouvelles opportunités, en générant des emplois dans des domaines tels que le développement de logiciels, la maintenance des systèmes intelligents et l'analyse de données. La requalification et la formation continue deviennent alors essentielles pour aider les travailleurs à s'adapter à ces changements.

Enfin, la question de l'IA générale (AGI) suscite de plus en plus d'intérêt. Alors que l'IA actuelle est dite "faible" ou "spécifique", c'est-à-dire qu'elle excelle dans des tâches précises, l'AGI viserait à développer une intelligence capable de rivaliser avec l'intellect humain dans une gamme étendue d'activités. Les débats sur l'AGI touchent à la fois à la faisabilité technique et aux implications éthiques, avec des questions sur la sécurité, la moralité, et les risques existentiels potentiels.

En somme, alors que l'IA continue de progresser à un rythme impressionnant, elle pose des questions profondes et urgentes auxquelles la société devra répondre.

Quelle(s) conclusion(s) en tirer ?

En revisitant l'histoire récente de l'IA, il est clair que nous vivons une époque de transformations profondes, qui ne sont donc pas une révolution inattendue. Depuis la renaissance des réseaux neuronaux dans les années 1990 jusqu'aux avancées spectaculaires de l'âge d'or de l'IA dans les années 2010, l'IA a fait ce qu’on attendait d’elle dans de nombreux domaines. Cependant, cette progression rapide s'accompagne de défis majeurs : l'éthique, la protection des données, l'impact sur le marché du travail, la protection de l’environnement et les questions entourant une possible IA générale.

L'avenir de l'IA est plein de promesses, mais il nécessite une approche réfléchie et collaborative pour maximiser ses bénéfices tout en atténuant les risques. Comprendre d'où vient l'IA et où elle pourrait nous mener est essentiel pour naviguer dans ce paysage en constante évolution.

Voilà, c’est tout pour aujourd’hui, à la semaine prochaine 😁

Bravo toujours au top ! C’est la seule newsletter que j’ouvre.